Група MLCommons, яка спеціалізується на розробці стандартів для штучного інтелекту, представила два нові тести MLPerf. Вони покликані оцінити, наскільки швидко сучасне обладнання та програмне забезпечення можуть запускати ШІ-додатки.

Нові тести від MLCommons

Від моменту запуску ChatGPT від OpenAI понад два роки тому, компанії почали активно розробляти апаратне забезпечення, яке може швидко та ефективно виконувати ШІ-код. Оскільки ШІ-моделі обробляють мільйони запитів щодня, нові бенчмарки MLPerf допоможуть виміряти їх реальну продуктивність та ефективність.

MLCommons розробив два нові тести, які оцінюють продуктивність ШІ-моделей у різних сценаріях. Перший тест, створений на основі Llama 3.1 від Meta, включає 405 мільярдів параметрів і використовується для оцінки загальних відповідей, математичних розрахунків і генерації коду. Він дозволяє перевірити здатність обробляти великі запити та синтезувати інформацію з різних джерел.

Другий тест також базується на відкритій моделі Meta та покликаний імітувати продуктивність, яку користувачі очікують від ШІ-асистентів. Основна мета – мінімізувати час відгуку та наблизити його до миттєвого реагування.

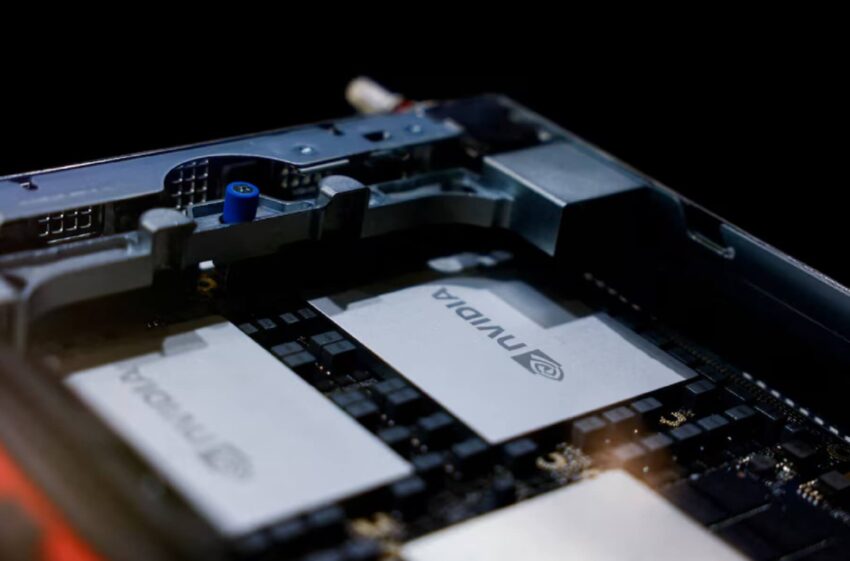

Компанія Nvidia представила кілька своїх новітніх ШІ-чіпів для тестування. Останнє покоління серверів Nvidia Grace Blackwell, які містять 72 графічні процесори, показало вражаюче зростання швидкості: продуктивність зросла в 2,8–3,4 рази порівняно з попереднім поколінням.

Результати цих тестів демонструють, що продуктивність ШІ-систем зростає шаленими темпами. Нові графічні процесори та оптимізовані архітектури серверів дозволяють розгортати більш потужні ШІ-моделі.