Компанія Google DeepMind заявила, що її оновлені моделі штучного інтелекту дозволяють роботам виконувати складніші завдання та навіть використовувати веб для отримання допомоги. Під час прес-брифінгу керівник підрозділу робототехніки Google DeepMind, Кароліна Парада, повідомила журналістам, що нові моделі ШІ працюють у тандемі, що дозволяє роботам «думати на кілька кроків вперед» перед виконанням дій у фізичному світі.

Як працюють оновленні моделі

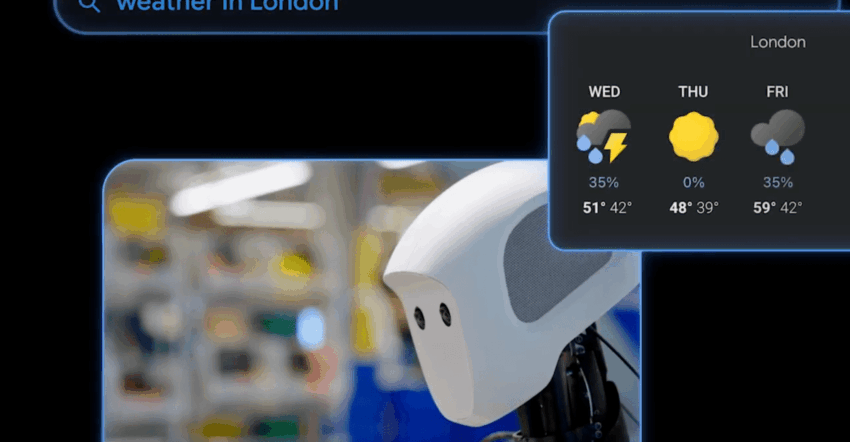

Система працює на основі нещодавно запущених моделей Gemini Robotics 1.5 та Gemini Robotics-ER 1.5, які є оновленнями AI-моделей, представлених Google DeepMind у березні. Тепер роботи можуть виконувати не лише одноразові завдання, такі як складання паперу або розгортання сумки. Вони здатні виконувати такі дії, як розділення білизни за кольором, упаковка валізи з урахуванням поточної погоди в Лондоні, а також допомога в сортуванні сміття, компосту та вторинних сировин на основі веб-пошуку, що відповідає специфічним вимогам місцевості.

«Моделі до цього часу могли добре виконувати одну інструкцію за раз у дуже загальному плані», — сказала Парада. «З цим оновленням ми переходимо від однієї інструкції до справжнього розуміння та розв’язання проблем для фізичних завдань.»

Для цього роботи використовують оновлену модель Gemini Robotics-ER 1.5, щоб зрозуміти навколишнє середовище та скористатися цифровими інструментами, такими як Google Search, для отримання додаткової інформації. Gemini Robotics-ER 1.5 потім перетворює ці дані на інструкції природною мовою для Gemini Robotics 1.5, що дозволяє роботу застосовувати розуміння зору та мови моделі для виконання кожного кроку.

Крім того, Google DeepMind оголосила, що Gemini Robotics 1.5 може допомагати роботам «вчитися» один від одного, навіть якщо вони мають різні конфігурації. Компанія виявила, що завдання, поставлені роботу ALOHA2, який складається з двох механічних рук, «просто працюють» на бі-руковому роботу Franka, а також на гуманоїдному роботу Apollo від Apptronik.

«Це дозволяє нам робити дві речі: перше — керувати дуже різними роботами, включаючи гуманоїдні, за допомогою єдиної моделі», — сказав програміст Google DeepMind Канішка Рао під час брифінгу. «По-друге, навички, які отримуються на одному роботу, тепер можуть бути передані іншому роботу.»

В рамках оновлення Google DeepMind розгортає Gemini Robotics-ER 1.5 для розробників через Gemini API у Google AI Studio, тоді як лише обрані партнери отримують доступ до Gemini Robotics 1.5.